SEO

クローラーとは?データ解析に欠かせない存在に迫る

2023年11月07日

目次

クローラーとは何か

クローラーの基本的な概念

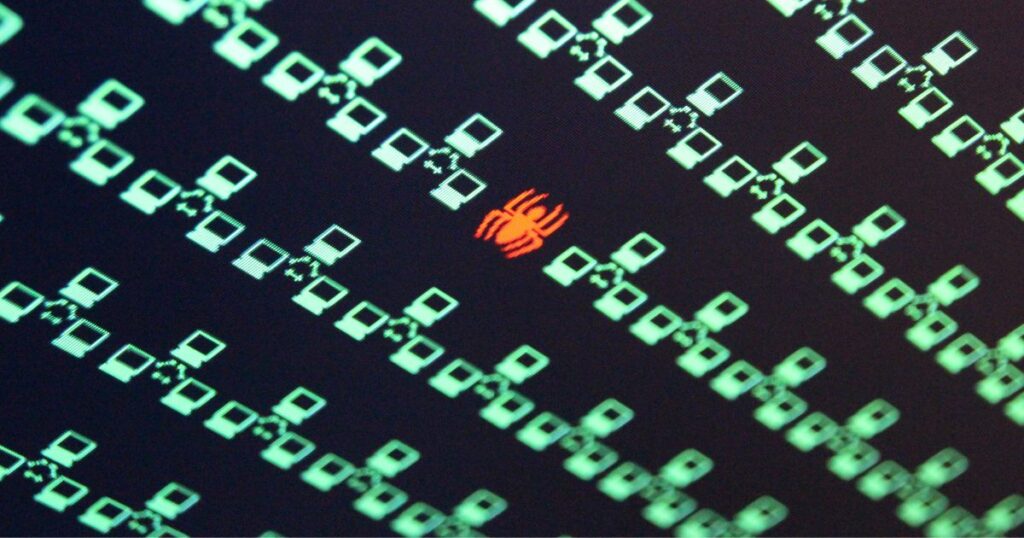

クローラーは、昼夜を問わず情報をインターネット上から探し出すロボットのような存在です。ある特定のウェブサイトを起点に、そこで提供されているリンク先を辿りながら情報を収集します。この一連の動作が、まるで虫が網を歩くかのように見えることから、英語では「スパイダー」つまり「蜘蛛」の名前がつけられています。 クローラーはあくまでそれがプログラムされた通りに動作し、人間のような意識を持つわけではありません。しかし、クローラーが情報を収集する元となるウェブサイトに載っている情報は、そのターゲットとなる情報を考え抜かれた形で提供されていることが多いです。 また、クローラーは情報の泉、つまりウェブサイトが新たに生まれ、その内容が次々と変わるにつれて、それらを巡回し続ける必要があります。そのため、クローラーが完全にその任務を終えることはありません。クローラーは常に新しい情報を求め、インターネットの世界を往還しています。クローラーが果たす役割

クローラーが果たす役割は大きく分けて二つです。一つ目は、インターネット上の情報を収集し、それを検索エンジンが利用可能な形に加工すること。二つ目は、収集した情報を基に各ウェブサイトのインデックス(索引)を更新し続けることです。 例えば、我々が何かの情報を探すためにGoogleなどの検索エンジンを利用するとき、その裏側でクローラーがひたすらに情報を収集し、その結果を検索エンジンに提供しています。さらには、その収集された情報を瞬時に加工し、我々の目の前に最も適した情報を提供することができるのも、クローラーのおかげです。 これらクローラーによる情報収集と加工が、我々がインターネットを利用する上で重要な役割を果たしていると言っても過言ではありません。クローラーの種類と特徴

クローラーには大きく分けて全文検索エンジン用クローラー、ディレクトリ型検索エンジン用クローラー、データベース型検索エンジン用クローラーの3つの種類があります。それぞれに異なる特性があります。 全文検索エンジン用クローラーは、その名の通り全文検索エンジンの情報源を提供します。ウェブサイトの全ての情報を文単位で捉え、それをユーザーが必要とする情報として適切に分類する仕事を行っています。そのため、ウェブサイトの情報を瞬間的、かつ正確に解釈する能力が求められます。 ディレクトリ型検索エンジン用クローラーは、ある特定のテーマやカテゴリに沿った情報を提供します。このタイプのクローラーは、情報がカテゴリごとに整理されているサイトから情報を収集する特性があります。 一方、データベース型検索エンジン用クローラーは、特定のデータベースから必要な情報を抽出する役割を果たします。このクローラーは、特に大規模なデータベースから高速に情報を取得するスキルを持っています。 これらを通して、様々な情報を正確に、迅速に取得し、我々に提供するのがクローラーの優れた特長です。クローラーの作り方

プログラミング言語とツールの選択

まずクローラーを作るためには、どのプログラミング言語とツールを使うか決めなければなりません。PythonやJavaなどのプログラミング言語が主に使われますが、特にPythonは可読性や簡易さが評価され、クローラー作成において多く用いられる選択肢の一つとなります。 一方で、プログラミングスキルがない方や手軽に作りたい方は、クローラービルダーやクローリングツールの利用も一つの選択肢となります。これらはプログラミングスキルを必要としないため、非技術者でも簡単にウェブサイトの情報を自動的に収集することが可能です。しかし、どの道具を選ぶかは最終的には目的とニーズによるので、あなたの目的に最適なツール選びが重要でしょう。必要な知識とスキル

クローラーを作る上で必要となる知識やスキルについて説明します。プログラミングスキルは、クローラー作成の基礎であり、特にウェブスクレイピングを行う場合には、HTMLやCSS、JavaScriptの知識が必要になります。また、ウェブサイトの構造を理解する能力も必要となります。さらに、サーバとの通信方法であるHTTPプロトコルの基礎知識や、APIの使い方なども覚えておきましょう。他にも、情報管理のためのデータベースの使い方、大量のデータをうまく処理するための並列・分散処理の知識も重要です。これら一連の知識とスキルを身につけることで、効率よく情報を収集するクローラーを作ることができます。クローラー作成の手順と注意点

クローラー制作の基本的な手順は、まずデータを取りたいウェブサイトの構造を理解します。次に、クローラーがどのようにサイトを巡回し、どの情報を取得するかを設計します。その後、実際にプログラミングを行い、テストを繰り返しながら調整を行います。最後に、定期的に動くようスケジューリングすることで完了です。 しかし、クローラーを使って情報を取得する際には、必ず各ウェブサイトのロボット排除規定(robots.txt)を確認しましょう。この規定に反する行為は違法となる可能性があります。また、大量にアクセスするとサイトに負荷をかけるため、アクセスの間隔を適切に設定することが求められます。それぞれのサイトの利用規約を尊重しつつ、情報収集を行うことが大切です。クローラーの正しい使い方

データ収集の基本ルール

データ収集における基本ルールを把握することは、クローラーの使用にあたって非常に重要です。まず第一に、自動的に情報を収集する行為は、そのサイトの運営者の意向やプライバシーに影響を与える可能性があります。したがって、サイト利用者のプライバシーを尊重し、適法で倫理的な手段でデータを収集することが求められます。さらに、ウェブサイトのサーバーに過度な負荷をかけないように、クローラーの動作速度を適切に調整する必要があります。これらの基本ルールを遵守することは、続く具体的な手順においても必須です。hrobots.txtの理解と尊重

次に、robots.txtの理解と尊重について説明します。robots.txtは、ウェブサイトの管理者がクローラーのアクセスを制御するためのファイルです。このファイルを元にクローラーがどの部分を巡回すべきか、または巡回すべきでないかを判断します。つまり、robots.txtはクローリングのルールブックのようなもので、無理解のままクローラーを作動させると予期しない問題が起きる場合があります。したがって、robots.txtの内容を理解し、尊重することがクローラーの適切な使い方と言えるでしょう。利用規約と法制度の理解

最後に、クローラーを使用する際は、それぞれのウェブサイトの利用規約や法的な制約を理解します。利用規約違反は法的なトラブルに発展することもありますので、事前に確認しておくことが必要です。また、情報の取得や利用は、知識産権やプライバシーの問題を孕んでいます。したがって、法的な規定やその他の法的制約について、確認し理解を深めてからクローラーを用いることが重要です。以上のことを理解し、クローラーを用いることで、効率的に情報を収集することができるでしょう。クローラーを用いたデータ分析

クローラーが集めたデータの解析方法

クローラーによって収集されたデータの解析には、データの前処理、変換、モデリングの各ステップが含まれます。初期の段階では、クローリングしたデータの前処理が必要で、ここでは不要な情報の除去や重複データの確認、各データ項目の格式化などが行われます。次に、データの変換がの工程では、一般的に収集されたデータを分析しやすい形式に変換します。最終的に、データモデリングが行われ、統計的な手法や機械学習のアルゴリズムを用いてデータセットのパターンを解析します。これらの各ステップは、クローラーによって集めたデータをより理解しやすく、より有用な形に整形するために必要なステップなのです。クローラーを活用した市場調査

市場調査においても、クローラーの活用は大いに貢献します。クローラーを使うことで、広範囲なウェブ上の情報を収集することが可能になります。例えば、競合企業の最新の動きや製品に対する顧客の感想、市場の動向を隅々まで探ることが可能になります。クローラーを使えば、多大な時間を投じずに大量のデータを収集することが可能です。ですから、市場調査においてクローラーは有益なツールとなります。クローラーを活用した市場調査は、迅速で正確な市場分析を可能にし、より効果的な戦略を立てるための鍵となるのです。ソーシャルメディア分析でのクローラーの活用

ソーシャルメディア分析では、ユーザーの意見や感情、行動パターンなどを把握することが一つの目標です。ここでもクローラーは非常に重要な役割を果たします。クローラーは、自動的にソーシャルメディアから大量の投稿データを収集します。そして、分析の対象となるこれらのデータを前処理と分析のステップに送ります。その結果、企業は顧客のニーズや市場の動向を把握することができます。また、クローラーを用いることで、リアルタイムな情報を継続的に把握することが可能になります。これによって、迅速な意思決定やマーケティング戦略の立案が可能となるでしょう。ソーシャルメディア分析でのクローラーの活用は、ユーザーとのコミュニケーション強化やブランドイメージの向上に貢献します。クローラーのトラブルシューティング

クローラーが適切に機能しない時の対処法

一般的に、クローラーが正しく機能しない場合、その最初の兆候はあります。それは、想定外のアクセスエラーだったり、何らかの要素が見つからなかったり、データ抽出が期待通りに進行しなかったりします。確認する方法としては、まずクローラーログをチェックし、それに続いて目的のウェブサイト構造を見直すことが必要です。それらを通して問題点を特定し、本質に迫ります。次に、問題を引き起こす可能性がある全ての変数を洗い出し、それぞれに対応する方法を構築します。さらには、適切なプログラミング言語またはフレームワークのバージョンを使用していることを確認し、互換性の問題や漏れを排除する必要があります。サイトのブロックからの回復方法

クローラーが適切に設定されていない場合、時折ウェブサイトがクローラーをブロックしてしまうことがあります。長期的な予防策として、クローラーのポリシー遵守と調整は一番の対策ですが、現行の問題を解決するまでの一時的な対策も重要です。ブロックされた場合、まず申立て手続きを行い、その原因を特定する必要があります。その後、問題を解決し、ブロック解除の申請を行います。特別な対応が必要な場合には、ウェブマスターとの連携が重要となります。法的な問題を回避するための対応

クローラーの活動は、ある程度の法的リスクを孕んでいます。その一部は、ウェブサイトへのアクセスやデータ収集といった行為が、著作権法やデータプライバシー法の範疇に触れる可能性があるからです。そうした問題を回避するためには、各国ごとの法令を遵守することが基本ですが、具体的には以下の注意点を覚えておくことが肝心です。まず、当然ですが、違法な情報収集は絶対に行わないこと。データ収集前に、対象のウェブサイトの利用規約を十分に読み込み、著作権法やプライバシーポリシーを尊重することが不可欠です。また、必要以上の頻度でサイトをクロールしないことも重要で、それによってウェブサイトの運営を妨げる行為は厳禁です。これらの対策を徹底することで、法的トラブルからクローラーを守ることが可能となります。クローラーの未来展望